Tekoäly on vakiinnuttanut nopeasti paikkansa yritysten arjessa ja muuttanut myös tavan kehittää ohjelmistoja. Tuotekehitysorganisaatioissa voi olla ohjelmistoja kehittämässä enemmän tekoälyagentteja kuin ihmisiä. Nopeaan muutokseen liittyy uusia kyberturvallisuusriskejä, joita ei täysin tunnisteta vielä tai niitä ei pysähdytä miettimään syvällisemmin.

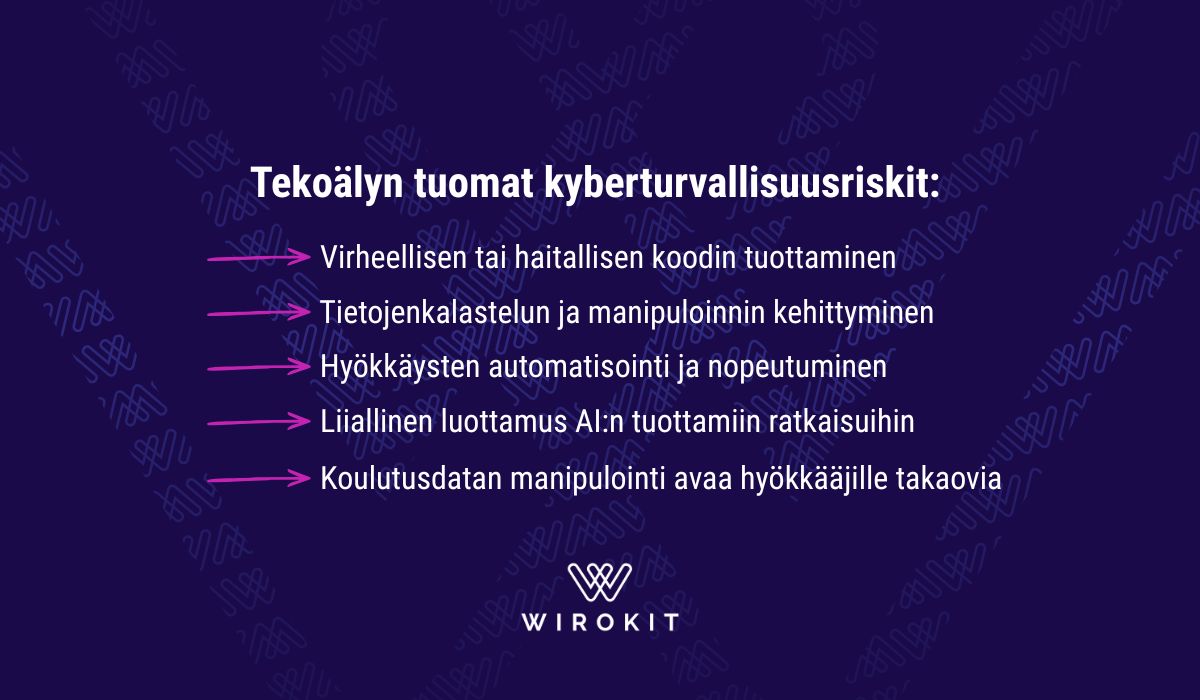

Tekoäly on mullistanut ohjelmistokehityksen nopeuttamalla koodin tuottamista ja tiedonhakua, mutta samalla se on tuonut mukanaan uusia, osin tunnistamattomia kyberturvallisuusriskejä. Kun tekoälyagentit yleistyvät tuotekehityksessä, kasvaa riski kriittisen yritysdatan ja luottamuksellisten tietojen päätymisestä ulkopuolisten saataville epähuomiossa. Tekoäly ei ainoastaan auta kehittäjiä, vaan se tarjoaa myös hyökkääjille tehokkaita työkaluja haavoittuvuuksien etsimiseen ja hyökkäysten automatisointiin, mikä kasvattaa yritysten hyökkäyspinta-alaa.

Turvallinen tekoälyn hyödyntäminen edellyttää asiantuntijoilta entistä korkeampaa ammattitaitoa ja kykyä arvioida tekoälyn tuotoksia kriittisesti. Tekoäly voi tuottaa vakuuttavan näköistä mutta virheellistä tai haitallista koodia, minkä vuoksi asiantuntijan rooli laadunvarmistajana korostuu. Yrityksiltä vaaditaan selkeitä toimintamalleja ja jatkuvaa valppautta, jotta uuden teknologian tarjoama tehokkuus ei vaaranna ohjelmistojen ja datan turvallisuutta.

Ohjelmistokehittäjän arki on muuttunut koodin tuottajasta koodin laadun valvojaksi. Pahimmillaan tekoälypalveluihin syötetään kriittistä yritysdataa, luottamuksellisia asiakastietoja tai sisäiseksi tarkoitettuja dokumentteja ymmärtämättä, miten tekoäly tietoa käsittelee tai mihin se voi päätyä. Tekoälyn myötä kyberuhat ovat jo muuttuneet ja tulevat tulevaisuudessa vain lisääntymään, mikä vaatii yrityksiltä jatkuvaa valppautta ja selkeitä toimintamalleja myös ohjelmistokehityksessä turvallisuuden varmistamiseksi.

AI toimii ohjelmistokehityksessä parhaimmillaan tehokkaana apuvälineenä, joka nopeuttaa tiedonhakua, auttaa ratkaisemaan ongelmia ja tukee ohjelmistojen rakentamista eri vaiheissa jopa tekemällä kaiken koodin itsenäisesti. Sen avulla kehittäjän ei tarvitse enää muistaa kaikkea ulkoa, vaan tietoa ja ratkaisuja voidaan tuottaa nopeasti. Wirokitin kriittisen ohjelmistokehityksen asiantuntija Sami Pitkänen syventyy parhaillaan tekoälyn hyödyntämiseen työnsä tukena Tampereen yliopiston GeTek-koulutuksessa. Pitkäsen mukaan koulutus on antanut syvempää ymmärrystä siitä, miten AI:tä voidaan hyödyntää vastuullisesti ohjelmistokehityksen tukena.

“Kun ymmärtää, miten mallit rakentuvat, miten data vaikuttaa lopputuloksiin ja missä tekoälyn rajoitteet ovat, sitä osaa käyttää paljon kriittisemmin ja tehokkaammin. Koulutus on auttanut hahmottamaan, mihin suuntaan teknologia on menossa ja miten sitä voi hyödyntää pidemmälle esimerkiksi osana ohjelmistokehityksen laadunvarmistusta”, hän kuvailee.

Samaan aikaan tekoäly tuo mukanaan myös uusia kyberturvallisuusriskejä. Tekoäly voi tuottaa virheellistä tai haitallista koodia, ja jos sen tuotoksiin luotetaan liikaa ilman asiantuntijan kriittistä arviointia, seuraukset voivat näkyä suoraan ohjelmistojen turvallisuudessa.

Wirokitin järjestelmäinsinööri Tuomo Tuominen näkee myös tekoälyn vaikutuksen kyberturvallisuuteen kaksijakoisena. Hänen mukaansa sama teknologia, joka auttaa yrityksiä kehittämään turvallisempia ohjelmistoja, antaa samalla hyökkääjille uusia ja aiempaa tehokkaampia työkaluja. Haavoittuvuuksien etsiminen, tietojenkalastelusisältöjen tuottaminen ja hyökkäysten automatisointi ovat tekoälyn avulla aiempaa nopeampia.

Ohjelmistokehityksessä tiedonhaku ja muiden ratkaisujen hyödyntäminen ovat olleet osa kehittäjän työtä jo pitkään. Tekoäly on kuitenkin muuttanut sitä, kuinka helposti vastaukset ja ratkaisut saadaan käyttöön. Samalla kasvaa riski ottaa tekoälyn tuottama ratkaisu liian helposti totuutena ilman riittävää asiantuntijan arviointia.

“Ammattitaito näkyy siinä, että osaa arvioida lopputuloksen, tunnistaa mahdolliset riskit ja tehdä oikeat päätökset. Turvallisuuden taustalla ovat edelleen ihmisen osaaminen, kriittinen ajattelu ja kyky tunnistaa ongelmat ajoissa. Tekoäly ei korvaa asiantuntijaa, vaan nostaa asiantuntijuuden vaatimustasoa”, Pitkänen täydentää.

Tekoälyn turvallisessa hyödyntämisessä tarvitaan kriittistä arviointia ja ymmärrys siitä, että tekoäly voi olla riski tietoturvalle yrityksessä. Pitkäsen mukaan yleinen virhe on luottaa tekoälyn tuottamaan sisältöön ilman riittävää arviointia.

“AI voi tuottaa vakuuttavan näköisiä vastauksia ja toimivaa koodia, mutta se ei tarkoita, että lopputulos olisi turvallinen tai edes oikein toteutettu. Samalla tekoälyn kehitys vaikeuttaa aidon ihmisen ja tekoälyn tuottaman sisällön erottamista, mikä kasvattaa erityisesti manipulointiin ja tietojenkalasteluun liittyviä riskejä”, Pitkänen korostaa.

Merkittävä riski liittyy myös datan käsittelyyn. Yrityksissä ei aina tiedosteta, mitä tietoa tekoälypalveluihin voidaan turvallisesti syöttää. Pahimmillaan AI-työkaluihin päätyy kriittistä yritysdataa, ohjelmiston lähdekoodia tai luottamuksellisia asiakastietoja ilman selkeitä toimintamalleja tai ymmärrystä siitä, miten tietoa käsitellään palvelun taustalla.

Tuomisen mukaan turvallinen AI:n käyttö lähtee ennen kaikkea tietoisuudesta ja selkeistä toimintatavoista. Yrityksien sisällä olisi tärkeä määritellä tarkasti, mitä tekoälylle saa syöttää, miten sen tuloksia arvioidaan ja kuka vastaa lopullisista päätöksistä. Yrityksellä joka asettaa tuotteen markkinoille on vastuu tietoturvasta: “Tiedämmekö mitä riskejä olemme hyväksymässä käyttöönottohetkellä?” Tuominen laittaa miettimään.

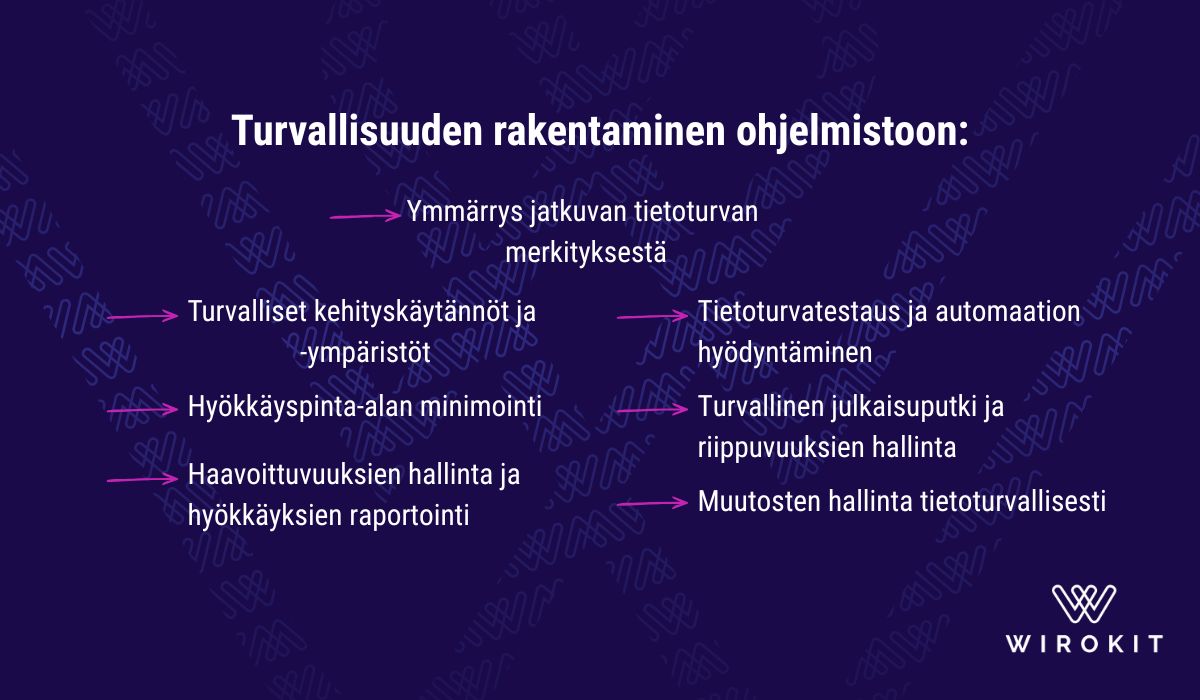

Turvallisuus ei ole yksittäinen projekti tai tila, joka saavutetaan kerran, vaan jatkuva osa yrityksen toimintaa ja myös ohjelmistokehitystä. Teknologia, hyökkäysmenetelmät ja ohjelmistojen haavoittuvuudet muuttuvat jatkuvasti, minkä vuoksi avain ohjelmistoturvallisuuden saavuttamiseen on aktiivisuus seurata ja reagoida muutoksiin koko ajan.

Ohjelmistojen tietoturvan ajankohtaisuutta lisää myös kiristyvä regulaatio. EU:n kyberturvallisuusvaatimukset, kuten tuleva Cyber Resilience Act, koskevat laajasti ohjelmistoja sisältäviä tuotteita, ja jatkossa vaatimusten täyttämisen on edellytys esimerkiksi CE-merkinnälle.

Kyberturvallisuuden kehittäminen ei kuitenkaan ole vain tekninen kysymys, vaan myös johtamisen asia. Ohjelmistoturvallisuus täytyy olla osana tuotekehitysstrategiaa. Pitkäsen mukaan vastuu turvallisuudesta alkaa organisaation johdosta. Jos johto ei ymmärrä kyberturvallisuuden merkitystä, turvallisuus ei toteudu myöskään käytännön tasolla henkilöstön arjessa. Kehitystiimillä täytyy olla riittävä osaaminen turvallisista kehityskäytännöistä. Jokaisen työntekijän tulisi ymmärtää, miten dataa käsitellään, millaisia riskejä tekoälyn käyttöön liittyy ja milloin mahdollisiin uhkiin pitää reagoida. Tietoturvan täytyy olla osa laatuprosessia ja ihmisillä pitää olla kyky tehdä riskiperusteisia päätöksiä.

Tekoälyavusteisessa ohjelmistokehityksessä korostuvat entistä enemmän ihmisasiantuntijan kyky hahmottaa kokonaisuuksia, arvioida eri vaihtoehtoja ja tunnistaa turvallisuuteen liittyviä riskejä. Sekä Pitkänen että Tuominen ovat sitä mieltä, että vaikka AI voi auttaa teknisessä toteutuksessa, ihmisen vastuulla on edelleen ymmärtää, miten ohjelmisto rakennetaan turvallisesti ja miksi tietyt ratkaisut tehdään. Ohjelmistokehitystiimissä on hyvä olla kriittisen koodin asiantuntijoita varmistamassa ratkaisujen luotettavuus.

Tekoäly voi nopeuttaa kehitystä merkittävästi, mutta turvallisuus, luotettavuus ja lopullinen päätöksenteko eivät siirry teknologialle. Mitä enemmän tekoäly automatisoi tekemistä, sitä tärkeämmäksi nousevat asiantuntijoiden kriittinen ajattelu, vastuunkanto ja kyky ohjata kehitystä oikeaan suuntaan. Jokaisen kehittäjän vastuulla on huolehtia ettei tekoälyavusteinen ohjelmistokehitys luo uusia kyberuhkia tai ettei ne ainakaan pääse realisoitumaan. Pidetään yhdessä verkottunut maailma huolista vapaana.

Ohjelmistoturvallisuuden varmistaminen tekoälyn aikakaudella on jatkuva prosessi, joka vaatii teknisen osaamisen lisäksi vahvaa johtamista ja strategista otetta. Kiristyvä sääntely, kuten EU:n Cyber Resilience Act, asettaa tulevaisuudessa tiukempia vaatimuksia ohjelmistojen turvallisuudelle, mikä tekee tietoturvasta välttämättömän osan laatuprosessia. Vastuu turvallisista toimintatavoista ja datan käsittelystä alkaa organisaation johdosta, mutta sen on jalkauduttava jokaisen kehittäjän arkiseen tekemiseen.

Vaikka tekoäly muuttaa työn tekemisen tapaa ja automatisoi teknisiä vaiheita, lopullinen vastuu ohjelmistojen luotettavuudesta ja turvallisuudesta säilyy ihmisellä. Asiantuntijoiden kriittinen ajattelu ja kyky tehdä riskiperusteisia päätöksiä ovat avainasemassa, kun navigoidaan tekoälyn tuomien mahdollisuuksien ja uhkien välillä. Huolellinen ja tiedostava suhtautuminen tekoälyyn varmistaa, että teknologia toimii kehityksen tukena luomatta hallitsemattomia kyberuhkia.